Es kommt wie aus dem Nichts. So dass jene Stunde, die eigentlich eine ehrenvolle Würdigung sein soll, in einem Desaster endet: Anlässlich des Gedenktages Yom HaShoah hat die Israelische Botschaft über Facebook zur digitalen Gedenkveranstaltung „Erinnerung im Wohnzimmer“ eingeladen. Jede und jeder, der möchte, kann sich zuschalten, um auf diese Weise der sechs Millionen Jüd:innen zu gedenken, die im Holocaust ermordet wurden. Aus Israel ist der 78-jährige Holocaust-Überlebende Tswi Herschel für ein offenes Gespräch zugeschaltet. Doch dazu kommt es nicht.

Plötzlich erscheinen Fotos von Adolf Hitler und pornografische Bilder auf den Bildschirmen der Teilnehmenden, im Hintergrund ertönen antisemitische Parolen. Unbekannte attackieren die digitale Gedenkveranstaltung. Sie wird abgebrochen, nur wenige Minuten nach Beginn.

Vorfälle wie diese häufen sich seit dem vergangenen Jahr, bekannt wurden sie als „Zoombombing“. Dem Bundesverband der Recherche- und Informationsstellen Antisemitismus zufolge sind allein seit Beginn der Coronakrise 2020 bis zum April desselben Jahres sechs solcher antisemitischer Online-Angriffe gemeldet worden. Häufig werden dabei pornografische Bilder gepostet, auch Bilder von Kindesmissbrauch. Laut einer Recherche des Magazins Vice ermittelte die Polizei in Deutschland im Mai 2020 in 16 Fällen, in denen Videokonferenzen durch das Zeigen von Videos mit sexuellem Missbrauch an Kindern brutal unterbrochen worden sind.

Auch Schüler:innen im Online-Unterricht sind davon betroffen: Anfang diesen Jahres wurden mehrere Fälle bekannt, in denen sich Unbekannte Zugang zu einer Lernplattform verschafften und auf den Bildschirmen der Grundschüler:innen pornografische Bilder einblendeten.

Zoombombing zeigt, wie digitale Gewalt in Zeiten der Pandemie und mit zunehmender Digitalisierung ein neues Ausmaß und neue Formen angenommen hat. In Großbritannien verdoppelten sich im April 2020 die Meldungen über bildbasierten sexuellen Missbrauch bei einem staatlich finanzierten Hilfetelefon im Vergleich zum April im Vorjahr, in Australien verdreifachten sich solche Meldungen von März bis Mai 2020, also während des ersten Lockdowns. Bei bildbasiertem sexuellen Missbrauch werden Nacktfotos oder -videos erstellt oder geklaut und ohne das Einverständnis der sichtbaren Personen auf Pornoseiten verbreitet.

Mein Körper ist nicht dein Porno⬆ nach oben

„Warum werden Videos von mir, die mich zeigen, als ich 15 Jahre alt war und die es nur gibt, weil ich erpresst wurde, immer wieder neu hochgeladen?“, fragt eine Frau namens Nicole in dem kürzlich erschienenen New York Times-Artikel „The Children of Pornhub“. Darin erzählt der Journalist Nicholas Kristof die Geschichten von Mädchen und jungen Frauen, die vergewaltigt oder sexuell missbraucht worden sind. Die Täter haben Videos von den Misshandlungen auf Pornhub hochgeladen. Pornhub ist nach xHamster jene Homepage in Deutschland, die Nutzer:innen am häufigsten aufrufen, wenn sie nach pornografischem Inhalt suchen.

Weil Pornhub bislang allen Nutzer:innen das kostenlose Herunterladen von Videos erlaubte, erscheinen auch solche immer wieder im Netz, die missbräuchliche Taten zeigen. Selbst dann, wenn die Videos gemeldet und – häufig erst in Folge einer Klage – von Pornhub entfernt worden waren. So wie die Videos von Nicole. Ihre Geschichte ist kein Einzelfall. Im Gegenteil: Pornhub, so Kristof, mache Geld mit sexuellem Missbrauch von Kindern, mit heimlichen Videoaufnahmen von duschenden Frauen mit versteckten Kameras, Aufnahmen von Vergewaltigungen sowie mit rassistischen und frauenfeindlichen Inhalten.

Eine aktuelle australische Studie, für die über 4.000 16- bis 49-Jährige befragt wurden, zeigt, wie verbreitet bildbasierter sexueller Missbrauch ist:

Kristof ist nicht der Erste, der darauf aufmerksam macht, dass auf Tube-Seiten wie Pornhub Tausende Videos mit illegalen Inhalten frei zugänglich sind. Schon seit Jahren gibt es sowohl von Pornodarsteller:innen als auch von Betroffenen sexualisierter Gewalt Kritik an der Funktionsweise der Seiten.

Dieser Text gehört zu unserem Zusammenhang „Fass mich nicht an!“. Darin beleuchten wir sexuelle Gewalt aus verschiedenen Perspektiven, aber auch, was man dagegen tun und wie man sich schützen kann.

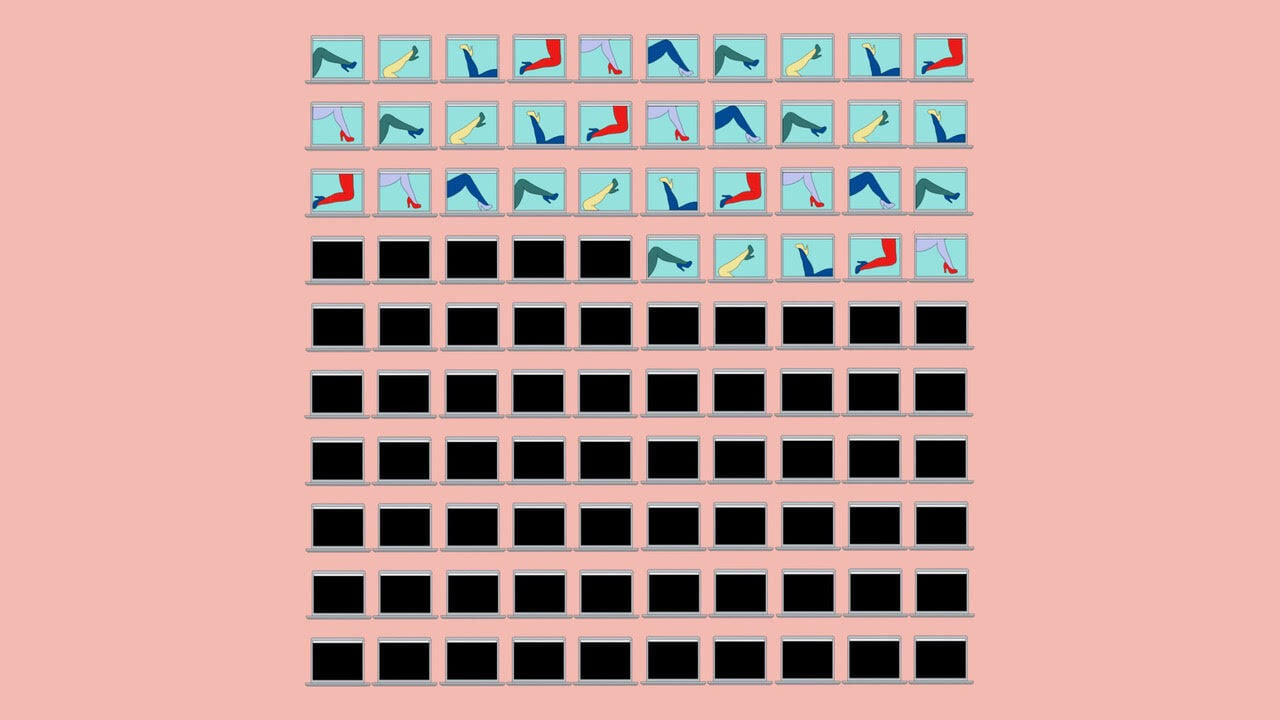

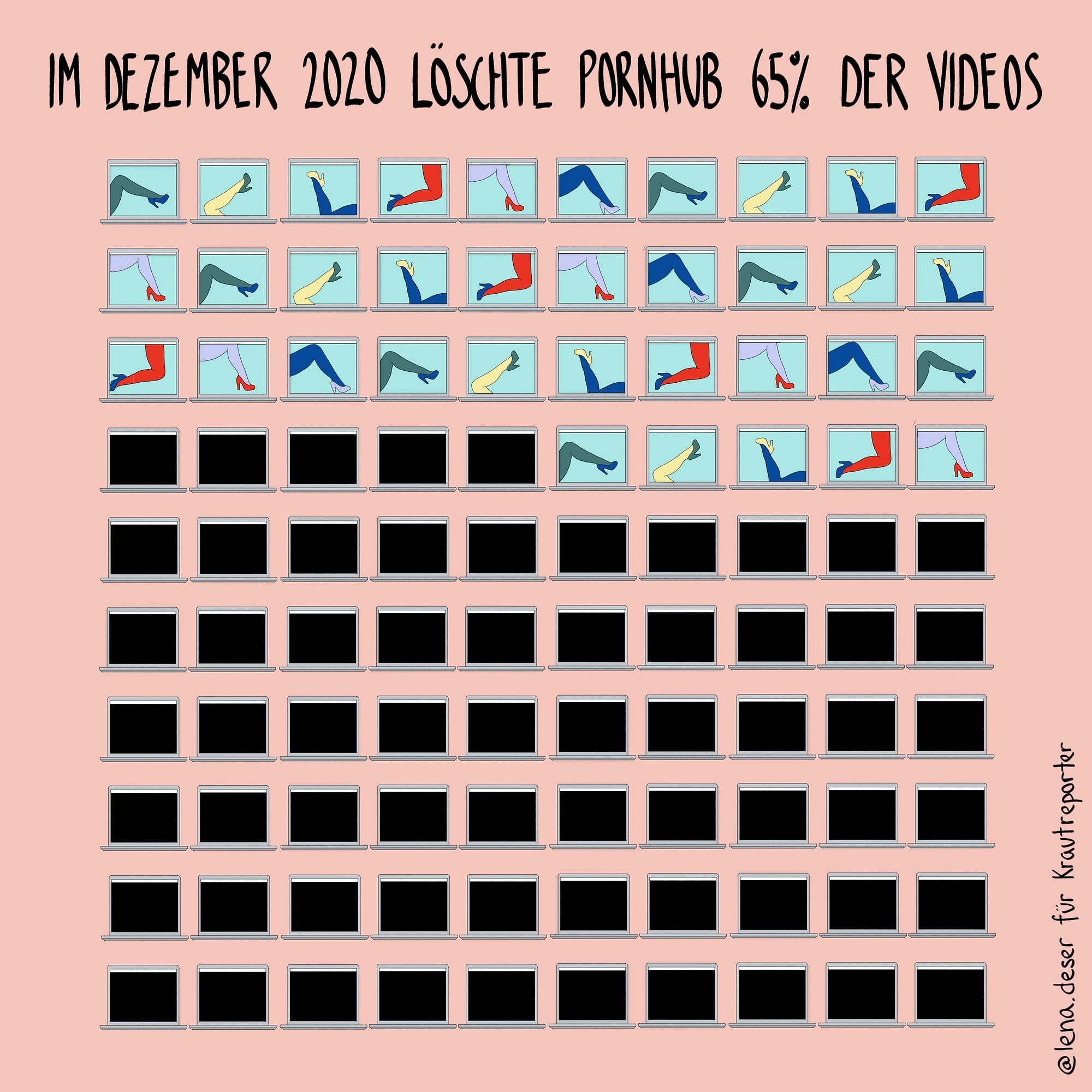

Doch erst als Kristofs Kolumne in der New York Times erschien, reagierte Pornhub. Zunächst, indem es Uploads von nicht verifizierten Nutzer:innen sowie das Herunterladen von Videos verbot. Doch erst, als wenige Tage später Visa und Mastercard bekannt gaben, ihre Karten nicht mehr für das Bezahlen von Pornhub-Videos nutzbar zu machen, änderte sich etwas: Pornhub veröffentlichte neue Sicherheitsstandards – und entfernte von einem Tag auf den anderen knapp neun Millionen Videos.

Doch das Teilen intimer Bilder ohne Einwilligung und oft auch ohne Kenntnis der Personen, die in den Videos zu sehen sind, ist nicht auf Pornhub beschränkt. Und die Beispiele zeigen, wie eng sexualisierte Übergriffe im öffentlichen Raum mit digitaler Gewalt verknüpft sind. Wenn Frauen öffentliche Toiletten, Umkleidekabinen, Solarien, Saunas oder Schwimmbäder benutzen, müssen sie damit rechnen, dass sie von winzigen versteckten Kameras gefilmt werden. Später tauchen diese Videos auf großen Pornoseiten auf. Dort kursieren sie häufig auch nach Meldungen noch tagelang.

Erst Anfang letzten Jahres wurde bekannt, dass ein Mitarbeiter des Festivals Monis Rache in Mecklenburg-Vorpommern über drei Jahre hinweg heimlich Videoaufnahmen auf Dixi-Klos gemacht und auf xHamster gestellt hatte. Kurze Zeit später veröffentlichten auch die Veranstalter:innen des Fusion-Festivals – das jährlich rund 70.000 Menschen besuchen – eine Stellungnahme: Auch auf ihrem Festival sei heimlich in Duschen gefilmt worden. Später fanden sich die Videos ebenfalls auf xHamster und zählten bis zu 36.992 Aufrufe – auch mehrere meiner Freundinnen besuchten die beiden Festivals.

So schnell kann es gehen: Auf einmal kommt einem diese abstrakt wirkende Sache, sexueller Missbrauch im Netz, erschreckend nah. Weil sexuelle Gewalt im Internet jede:n treffen kann.

Und plötzlich landet dein Gesicht in einem Porno⬆ nach oben

Denn auch, wer noch nie eine öffentliche Toilette oder Dusche besucht, sich noch nie beim Sex gefilmt, noch nie – freiwillig oder unfreiwillig – Nacktfotos übers Internet versendet und noch nie einen sexuellen Übergriff erlebt hat, kann sein Gesicht plötzlich in einem Porno entdecken. Genau das ist der britischen Schriftstellerin und Lyrikerin Helen Mort passiert: Ende vergangenen Jahres entdeckte ein Bekannter ihr Gesicht auf einer Pornoseite. Sexuell explizite, teilweise gewaltvolle Bilder. Dabei hatte sie solche nie von sich gemacht, geschweige denn mit anderen geteilt.

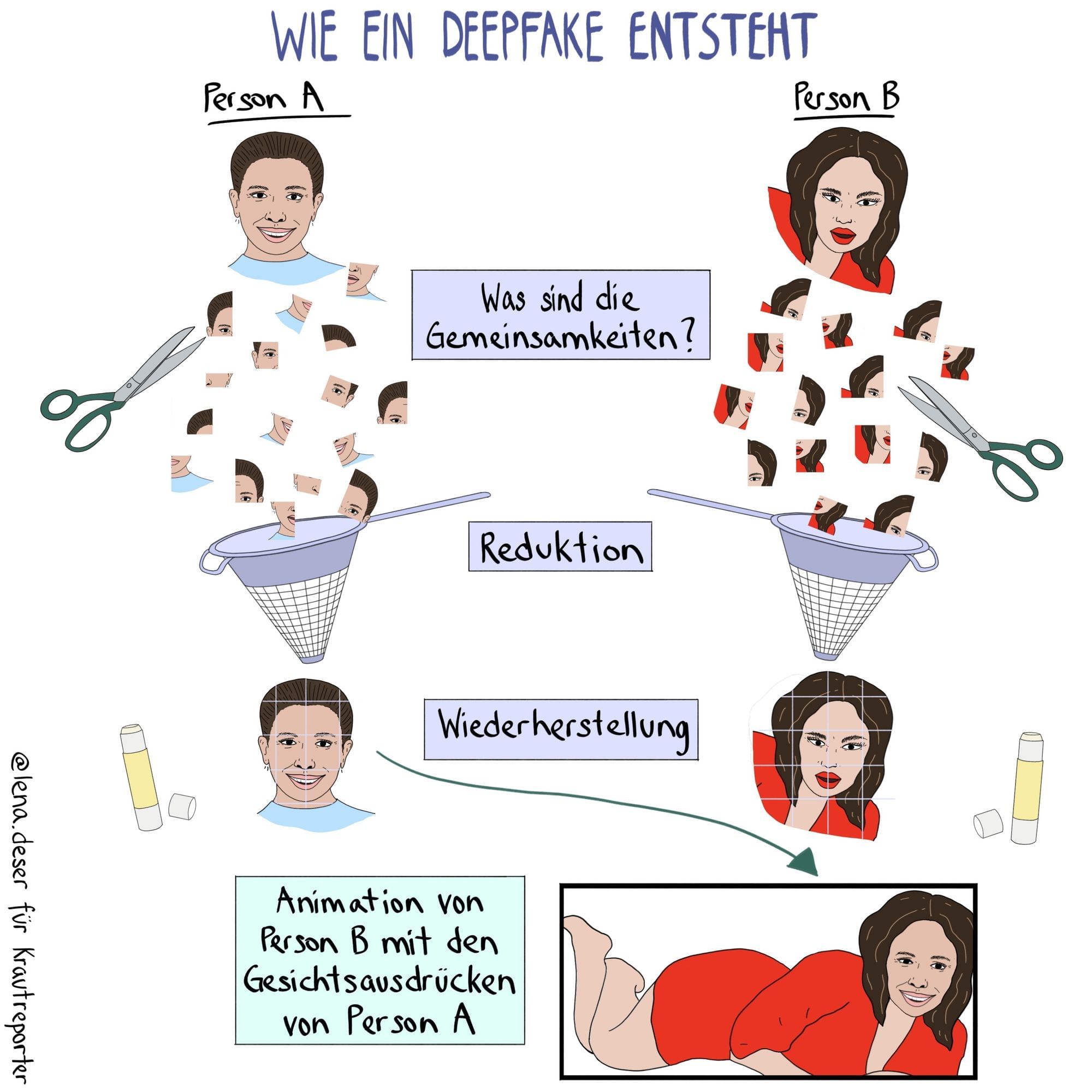

Wie Morts Bilder trotzdem auf eine Pornoseite gelangten? Ein unbekannter Täter hatte über drei Jahre hinweg Fotos von ihren Social-Media-Profilen entnommen und zusammen mit ihrem Vornamen auf eine Pornoseite gestellt. Urlaubs- und Schwangerschaftsfotos, Fotos von Mort aus Teenagerzeiten. Schließlich hatte der Täter andere dazu eingeladen, diese Fotos zu bearbeiten, sie in demütigende gewaltvolle und sexuell explizite Bilder zu verändern; solche gefälschten Bilder nennen Expert:innen Deepfakes – zusammengesetzt aus Deep Learning (einer Methode des maschinellen Lernens) und Fake (auf Deutsch: Fälschung).

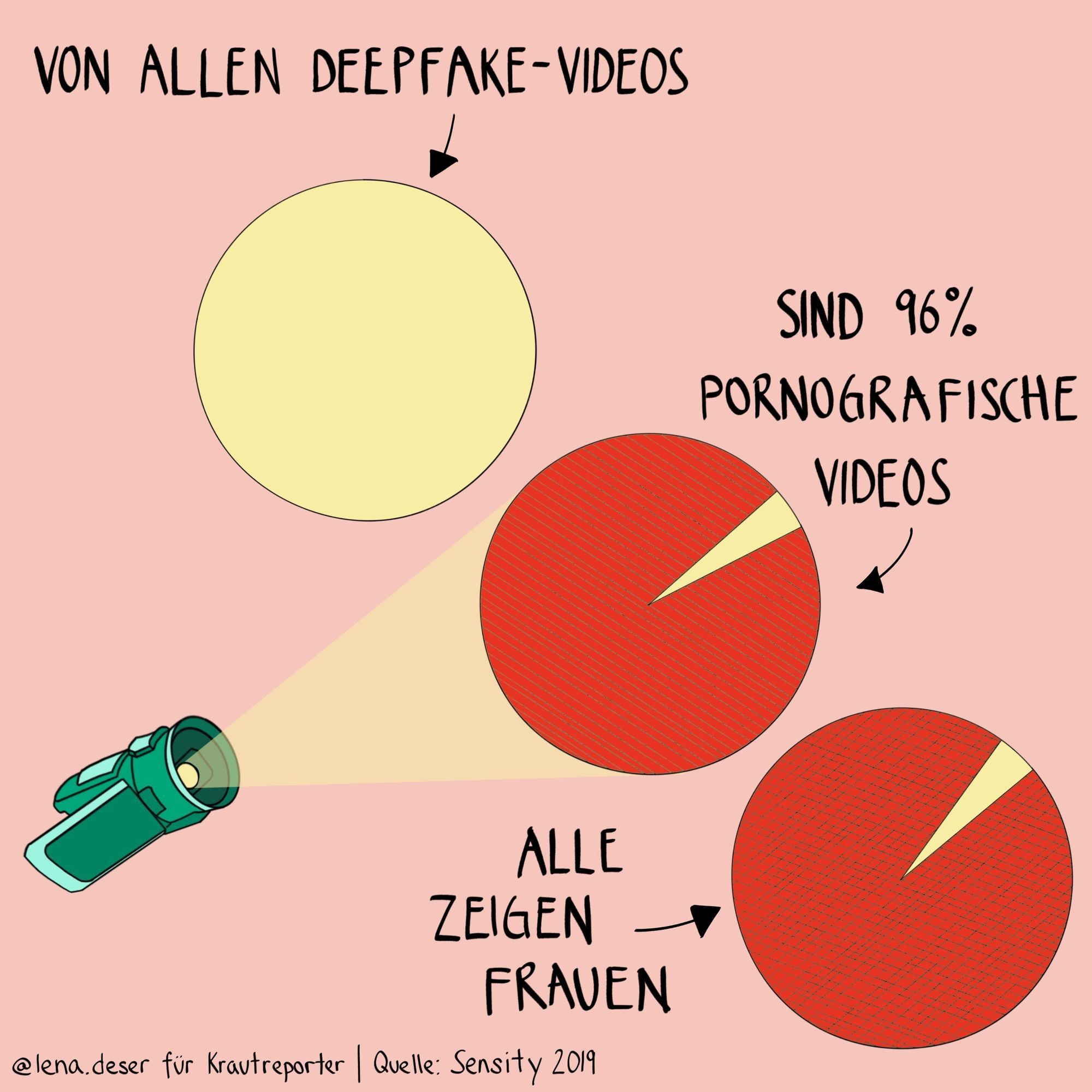

Mithilfe von Künstlicher Intelligenz entstehen so scheinbar echte Fotos, Videos oder Tonaufnahmen von Menschen. So echt, dass sie mit bloßem Auge kaum als Fälschung entlarvt werden können. Laut des niederländischen Unternehmens Sensity, das sich auf KI-Technologien zur Erkennung von Deepfakes spezialisiert hat, stieg die Gesamtzahl der Deepfake-Videos im Internet von Dezember 2018 bis Juli 2019 um fast einhundert Prozent.

Mediale Aufmerksamkeit bekommen Deepfakes vor allem dann, wenn Politiker:innen betroffen sind. Doch die überwältigende Mehrheit von Deepfake-Videos sind pornografisch – und zeigen ausschließlich Frauen:

Häufig sind Frauen betroffen, die in der Öffentlichkeit stehen. Das Ziel der Täter: Demütigung und Entmenschlichung. So wurde zum Beispiel ein Video, in dem die US-amerikanische Schauspielerin Bella Throne über den Tod ihres Vaters weint, zu Pornografie editiert und verfremdet. Die Technologie wird immer besser, die Programme immer einfacher und zugänglicher. Mittlerweile können auch Laien ohne große Programmierkenntnisse Deepfakes in hoher Qualität erstellen.

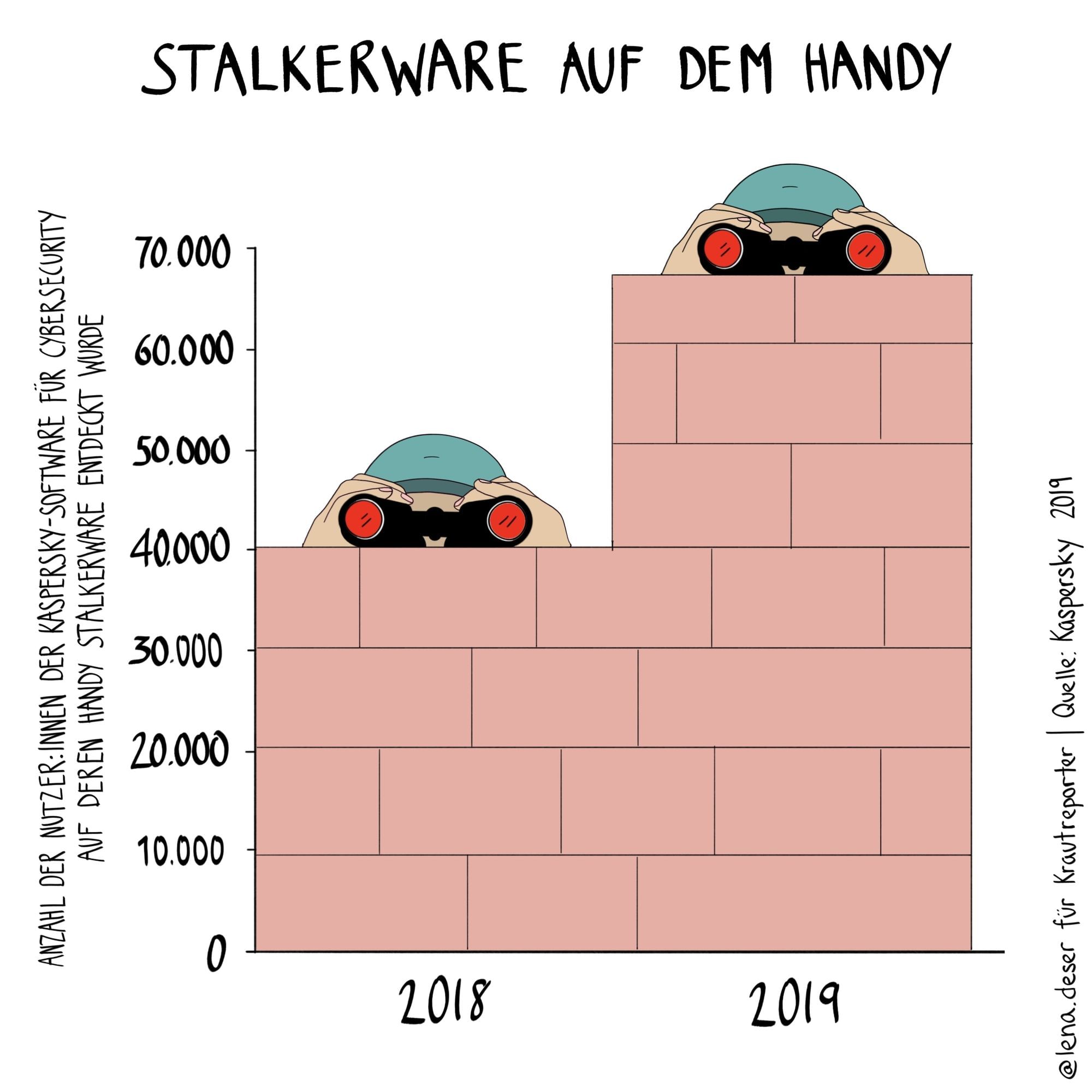

Nicht immer jedoch sind die Täter bei digitaler sexueller Gewalt fremd. Immer häufiger nutzen gewalttätige (Ex-)Partner digitale Technologien, um ihre (Ex-)Partnerin zu kontaktieren, zu verfolgen und zu terrorisieren. Mittlerweile hat sich ein eigener Begriff dafür etabliert: Cyberstalking. Die Überwachung mittels Stalkerware – Apps und Software, mit denen Menschen heimlich beobachtet und verfolgt werden können – hat in den vergangenen Jahren stark zugenommen. Laut des Stalkerware Reports liegt Deutschland im internationalen Vergleich auf Platz fünf derjenigen Länder, in denen Nutzer:innen im Jahr 2019 Stalkerware auf ihren Geräten entdeckt haben.

Für Frauen, die von häuslicher Gewalt betroffen sind, hat das fatale und möglicherweise tödliche Folgen: Wenn eine Betroffene auf ihrem Handy Stalkerware entdeckt und löscht, alarmiert die Software den Täter. Laut der Wissenschaftlerin Jane Monckton-Smith steigt das Risiko enorm für einen Femizid, wenn der Täter befürchtet, dass sich seine Partnerin trennen könnte. Zudem erschwert Stalkerware die Flucht an einen sicheren Ort und verrät im schlimmsten Fall die Adresse eines Frauenhauses.

Geschlossene Schulen bedeuten für Täter:innen mehr Chancen für Kindesmissbrauch⬆ nach oben

Aber nicht erst erwachsene Frauen, auch Kinder sind von der zunehmenden digitalen Gewalt betroffen. Und das in Zeiten anhaltender Lockdowns in immer höherem Ausmaß. Denn auch das Leben von jüngeren Kindern findet infolge der Schulschließungen verstärkt online statt. Schon vor der Corona-Pandemie, im Jahr 2018, nutzten über ein Drittel der Sechs- und Siebenjährigen das Internet. Unter den 12- und 13-Jährigen waren es 94 Prozent. Für Täter:innen bedeutet das: mehr potenzielle Opfer, neue Chancen für Missbrauch.

Bereits vor der Pandemie lag die Verbreitung von missbräuchlichem Bildmaterial mit Kindern als Opfern auf einem dramatisch hohen Niveau. Zur Veranschaulichung: Der US-amerikanischen Organisation „National Center for Missing and Exploited Children“ wurden 1998 über 3.000 Bilder und Videos von sexuellem Missbrauch von Kindern gemeldet. 2014 überstieg diese Zahl erstmals die Eine-Million-Marke, im Jahr 2018 waren es 18,4 Millionen Bilder.

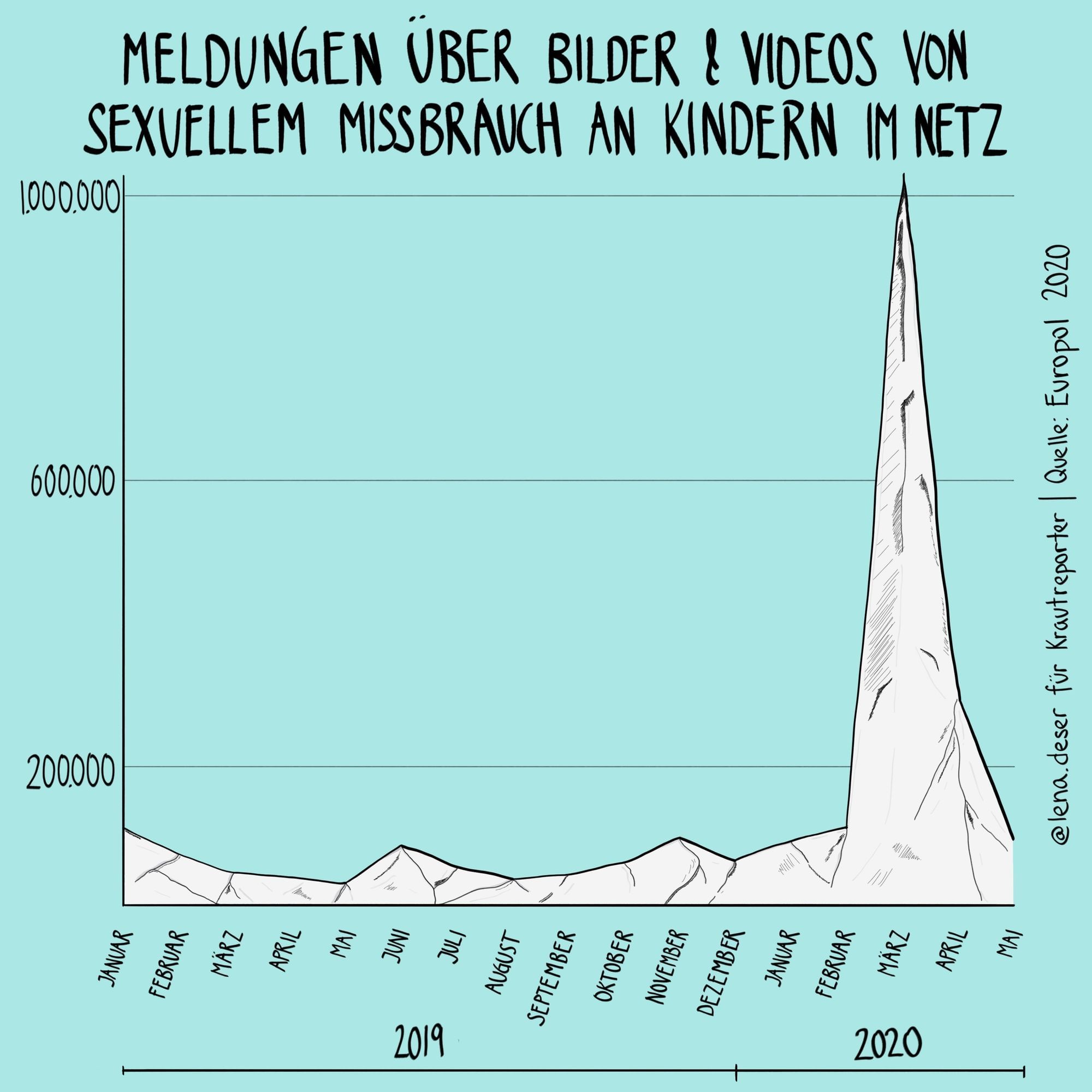

Mit Beginn des ersten Lockdowns verzeichnete Europol, die Strafverfolgungsbehörde der EU, einen massiven Anstieg der Meldungen über sexuellen Missbrauch von Kindern im Internet:

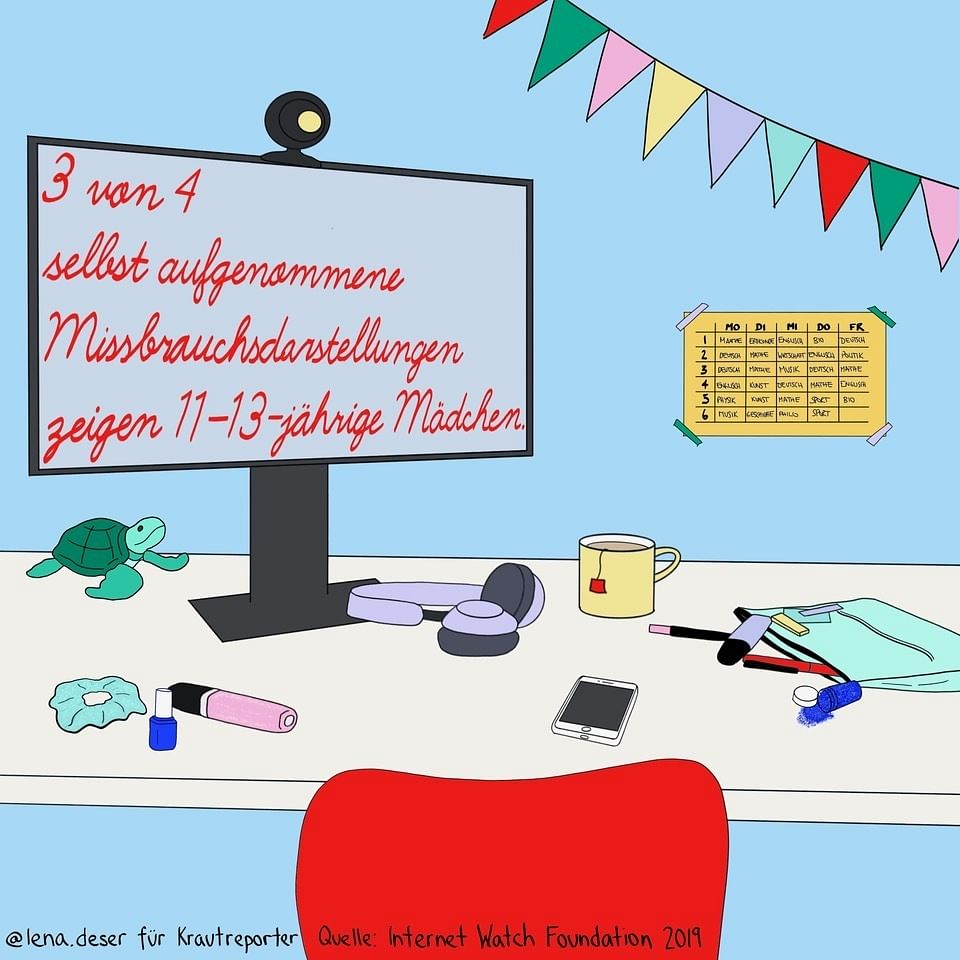

Auch die Aktivitäten von Täter:innen in Online-Netzwerken und Dark-Web-Foren haben seit Beginn der Corona-Krise zugenommen. In einem erschreckenden Bericht zitiert Europol enthusiastische Nachrichten über die „neuen Möglichkeiten“, die sich den Täter:innen bieten, wenn Kinder während des Lockdowns häufiger unbeaufsichtigt online sind. In den Foren teilen die Täter:innen Videos, die ohne das Wissen der Kinder per Webcam aufgenommen wurden, aber immer häufiger auch Videos, die die Kinder selbst zu Hause von sich aufgenommen haben. Laut der Internet Watch Foundation nimmt der Anteil selbst aufgenommener Bilder immer stärker zu. Und auf fast allen dieser Bilder und Videos sind Mädchen zu sehen:

Auch jüngere Kinder sind betroffen: 13 Prozent der Bilder oder Videos zeigen ein Mädchen im Alter von sieben bis zehn Jahren. Manchmal nehmen sich die Kinder freiwillig auf, für Likes in sozialen Netzwerken, zum Spaß für Freund:innen, als Flirt für den aktuellen Crush. Geraten diese Fotos in falsche Hände, ist die weitere Verbreitung kaum noch zu stoppen. Häufig werden die Kinder oder Jugendlichen jedoch überredet, gezwungen und erpresst. Manche Täter geben sich als gleichaltrig aus und bauen über Wochen eine Beziehung und Vertrauen zu den Opfern auf, auch bekannt als Cyber-Grooming. Europol nennt sexuelle Nötigung und Erpressung im Internet das neue Kriminalitätsphänomen des digitalen Zeitalters. In den meisten Fällen sind Mädchen und Frauen betroffen.

Bei der Recherche dieser Fakten konnte ich tagelang nicht abschalten. Ich erinnerte mich, wie ich selbst Anfang der 2000er Jahre, mit zwölf Jahren, nichtsahnend mit Freundinnen am Computer der Eltern mit Fremden chattete. Auch wir erhielten innerhalb weniger Minuten Anfragen fremder Männer: „Was hast du an?“, „Schickst du mir ein Foto von dir?“, „Na, Lust zu telefonieren?“ Ohne Smartphones oder Webcam konnten wir zum Glück noch nicht einmal auf den Gedanken kommen, ein Foto von uns zu verschicken. Von den Nachrichten erzählten wir niemandem; zu eklig, zu verboten fühlte sich das an.

Auch heute, zwanzig Jahre später, ist das Wissen über digitale Gewalt viel zu gering: Sloane Ryan beschreibt bei Krautreporter in einem schockierenden Bericht, was sie erlebt, als sie sich im Internet als elfjähriges Mädchen ausgibt. Das tut sie, um bei Eltern, die nicht selbstverständlich mit dem Internet aufgewachsen sind, ein stärkeres Bewusstsein für die Gefahren für Kinder im Internet zu wecken.

Betroffene erheben ihre Stimme, weil Strukturen und Gesetze fehlen⬆ nach oben

Auch ich hielt die Angst vor versteckten Kameras auf öffentlichen Toiletten für übertrieben, vielleicht sogar paranoid, bis die Vorfälle auf den beiden Festivals bekannt wurden. Und auch ich dachte, ich könnte mich vor Missbrauch schützen, indem ich keine intimen Bilder von mir ins Netz stelle oder verschicke. Jetzt weiß ich, dass ich damit falsch lag.

Als Helen Mort ihren Fall der Polizei anzeigte, wurde ihr gesagt, sie sei schon die dritte Person an diesem Tag, die solch einen Fall meldete. Doch die Polizei könne leider nichts tun, denn Deepfakes seien bislang in Großbritannien keine Straftat. Deshalb hat Helen Mort eine Petition initiiert, in der sie die britische Regierung auffordert zu handeln und ein Gesetz zu verabschieden, das die Aufnahme, Herstellung und Fälschung von Deepfake-Pornos verbietet.

Helen Mort ist nicht die einzige betroffene Frau, die sich so gegen das Gefühl der Ohnmacht und des Ausgeliefertseins wehrt. In Deutschland hat eine junge Frau namens Anna gemeinsam mit den Organisationen Anna nackt, Am I in Porn und HateAid eine Petition gegen bildbasierten sexuellen Missbrauch gestartet. Damit endlich etwas passiert. Denn auch sie hat erlebt, dass Bilder und Videos von ihr gemeinsam mit ihrem Vor- und Nachnamen sowie einem Screenshot ihres Facebook-Profils plötzlich auf mehreren Pornoseiten auftauchten. Ihre Cloud wurde gehackt, die Bilder geklaut. Sie erfuhr davon, weil ein alter Schulfreund ihre Bilder entdeckte und ihr eine SMS schrieb.

Auch Anna hat erlebt, wie schwer es ist, als Betroffene ernst genommen zu werden und Unterstützung zu bekommen. Bei der Polizei bekam sie den Rat, sie solle doch mal bei Google anrufen – und sie wurde gefragt, ob sie sich wirklich sicher sei, dass sie die Bilder nicht doch selbst hochgeladen habe.

Annas Bilder werden immer wieder aufs Neue online gestellt. Das ist das besonders Abscheuliche an digitaler sexueller Gewalt: Sie findet unter den Augen von Millionen anonymer Zuschauer:innen statt, wieder und wieder. Viele Betroffene fühlen sich gedemütigt, beschämt und bedroht. Viele schweigen.

Anna und Helen Mort schweigen nicht, sondern gehen an die Öffentlichkeit. Das tun sie, weil Strukturen und Gesetze fehlen, die Betroffene schützen könnten. Und weil das Bewusstsein für die Gefahren digitaler Gewalt gering ist – nicht nur in der gesamten Gesellschaft, sondern vor allem auch bei Beratungsstellen, der Polizei und Strafverfolgungsbehörden. Zu diesem Fazit kommt auch das gerade veröffentlichte Gutachten „Digitalisierung geschlechtergerecht gestalten“ für den Dritten Gleichstellungsbericht der Bundesregierung.

Um die Kontrolle zurückzugewinnen, hat Helen Mort als Antwort auf ihren Missbrauch ein Gedicht veröffentlicht. Der BBC sagte sie dazu: „Die Absicht der Täter, wie sie in ihrem Posting sagten, war es zu demütigen. Sie sagten, sie wollten diese Person gedemütigt sehen, und ich dachte, na ja, eigentlich bin ich nicht gedemütigt. Und ich werde mich dazu äußern, weil ich nicht diejenige sein sollte, die sich schämt.“

Redaktion: Esther Göbel; Illustrationen: Lena Deser; Schlussredaktion: Susan Mücke; Audioversion: Iris Hochberger